💯【超星学习通满分助手】支持LLM智能答题

💯 超星学习通满分助手

自动完成超星学习通所有任务点的 Tampermonkey 油猴脚本,支持题库查询与 LLM 智能答题双引擎。

支持的域名

| 域名 | 说明 |

|---|---|

*.chaoxing.com |

超星学习通主站 |

*.edu.cn |

各高校教育网 |

*.nbdlib.cn |

宁波数字图书馆 |

*.hnsyu.net |

湖南省学院 |

*.gdhkmooc.com |

广东开放大学 |

界面说明

脚本加载后页面右下角出现一个红色圆形按钮(⚙),点击打开配置面板。

页面左侧中部出现一个绿色悬浮按钮(◉),显示当前任务状态,点击打开运行面板。

配置面板

包含五个标签页:

| 标签 | 说明 |

|---|---|

| 快速配置 | 最常用开关的快捷入口 |

| 基础配置 | 通用间隔、答题间隔等时间参数 |

| 章节配置 | 章节任务的详细开关与正确率阈值 |

| 作业/考试配置 | 考试自动切换开关 |

| LLM 配置 | AI 答题的全部参数 |

底部按钮:保存(生效需刷新页面)、导出(复制配置 JSON)、导入(粘贴 JSON 恢复配置)、测试 LLM(验证 API 连通性)。

运行面板

包含三个标签页:

- 运行框:实时显示当前题目、答案、题号导航、各题库接口返回详情

- 运行日志:带时间戳的操作日志,最多保留 20 条

- 公告:脚本使用须知

自动化功能

自动答题

开启后脚本自动向题库接口查询答案并填写,支持以下题型:

- 单选题 / 多选题 / 判断题

- 填空题 / 简答题 / 名词解释 / 论述题 / 计算题

最低正确率(默认 0.8):题库返回答案的置信度低于此值时不自动提交,避免错误提交。

自动切换章节

完成当前章节所有任务点后自动跳转到下一章节,无需手动操作。

自动提交答案

答题完成且满足最低正确率后自动提交,无需手动点击提交按钮。

考试自动切换

考试模式下自动切换题目。

LLM 智能答题

题库查询无结果时,自动调用你配置的 AI 模型进行答题。所有供应商统一使用 OpenAI 兼容格式,无需区分 API 类型。

什么时候会用到 LLM?

脚本优先查询免费题库(icodef、不挂科等),只有题库里找不到答案时才会调用 AI。所以 LLM 是兜底手段,不是必须配置的。如果你的课程题目比较冷门、题库命中率低,配置 LLM 可以大幅提升答题覆盖率。

第一步:选择一个 AI 供应商

下表列出了所有内置预设。推荐新手选择 DeepSeek 或 Kimi,国内访问稳定、价格便宜,注册也不需要科学上网。

| 供应商 | 特点 | 获取 API Key |

|---|---|---|

| DeepSeek | 国内访问,价格极低,效果好 | platform.deepseek.com |

| Kimi (Moonshot) | 国内访问,中文理解强 | platform.moonshot.cn |

| 通义千问 | 阿里云,国内访问,有免费额度 | bailian.console.aliyun.com |

| 智谱 GLM | 国内访问,glm-4-flash 免费 | open.bigmodel.cn |

| 小米 Mimo | 国内访问 | platform.xiaomimimo.com |

| OpenAI | 需要科学上网, | platform.openai.com |

| Anthropic (Claude) | 需要科学上网 | console.anthropic.com |

| 自定义 | 本地 Ollama、中转代理等 | 手动填写 |

第二步:注册账号并获取 API Key

以 DeepSeek 为例(其他平台流程类似):

- 打开 platform.deepseek.com,用手机号注册并登录

- 进入「API Keys」页面,点击「创建 API Key」

- 给这个 Key 起个名字(随意),点击确认

- 立即复制弹出的 Key(格式类似

sk-xxxxxxxxxxxxxxxx)

重要:API Key 只在创建时显示一次,关闭弹窗后就看不到完整内容了,务必先复制保存。

充值方面,DeepSeek 按 token 计费,答题场景用量极小,充值 1 元可以用很久。

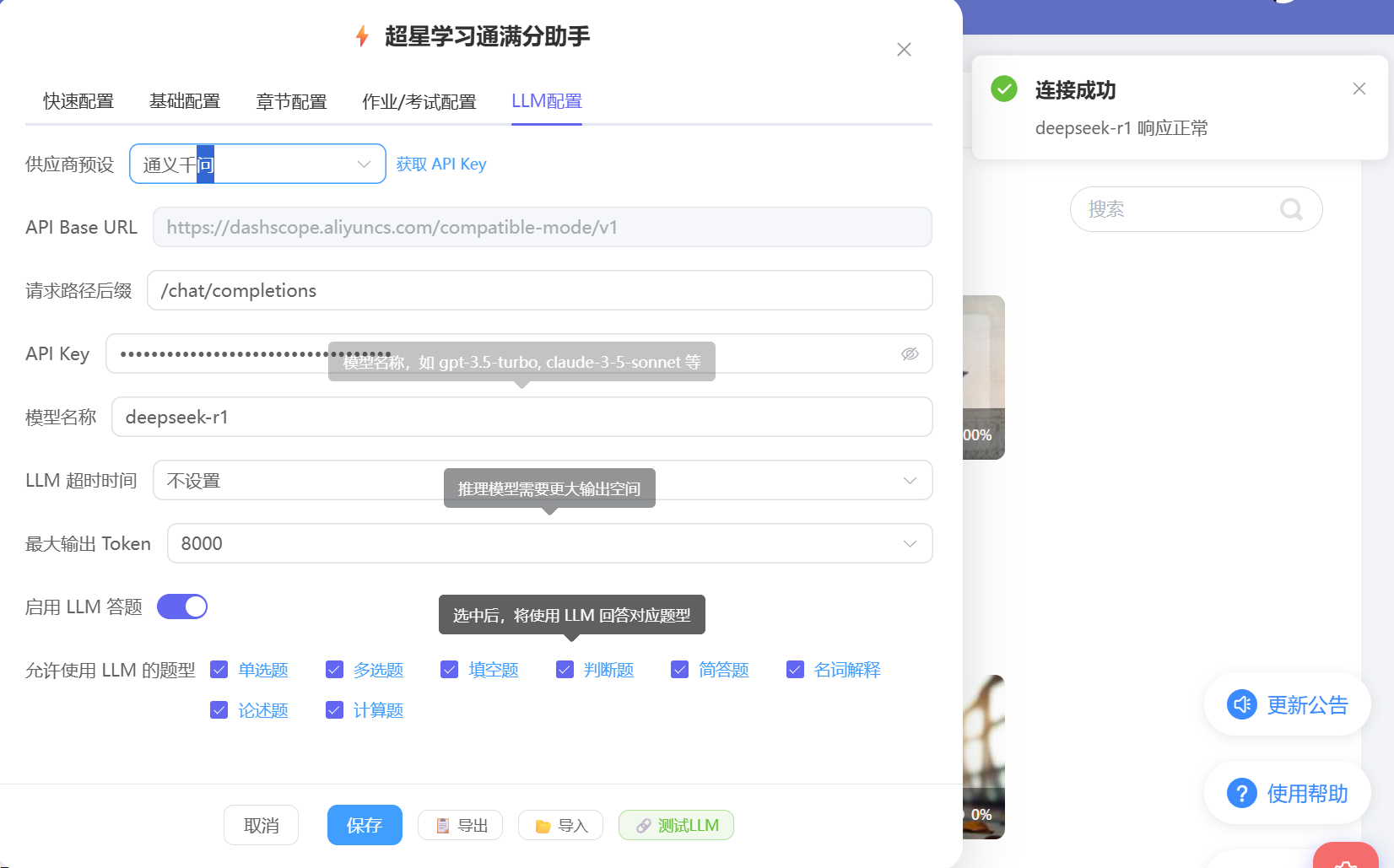

第三步:在脚本中填写配置

- 打开学习通页面,点击右下角红色 ⚙ 按钮

- 切换到 LLM 配置 标签页

- 供应商预设 下拉选择你注册的平台(如 DeepSeek)

- 选择后 Base URL 和请求路径后缀会自动填入,不需要手动改

- 选择后右侧会出现「获取 API Key」链接,可直接跳转到对应平台

- API Key 填入刚才复制的 Key(

sk-xxx...) - 模型名称 填入你要使用的模型,例如:

DeepSeek:``deepSeek-V4-flash 或 deepseek-v4 pro`(推理,更慢但更准)

Kimi:

kimi-k2.6通义千问:

qwen-plus阿里百炼目前有免费额度。可以尝试

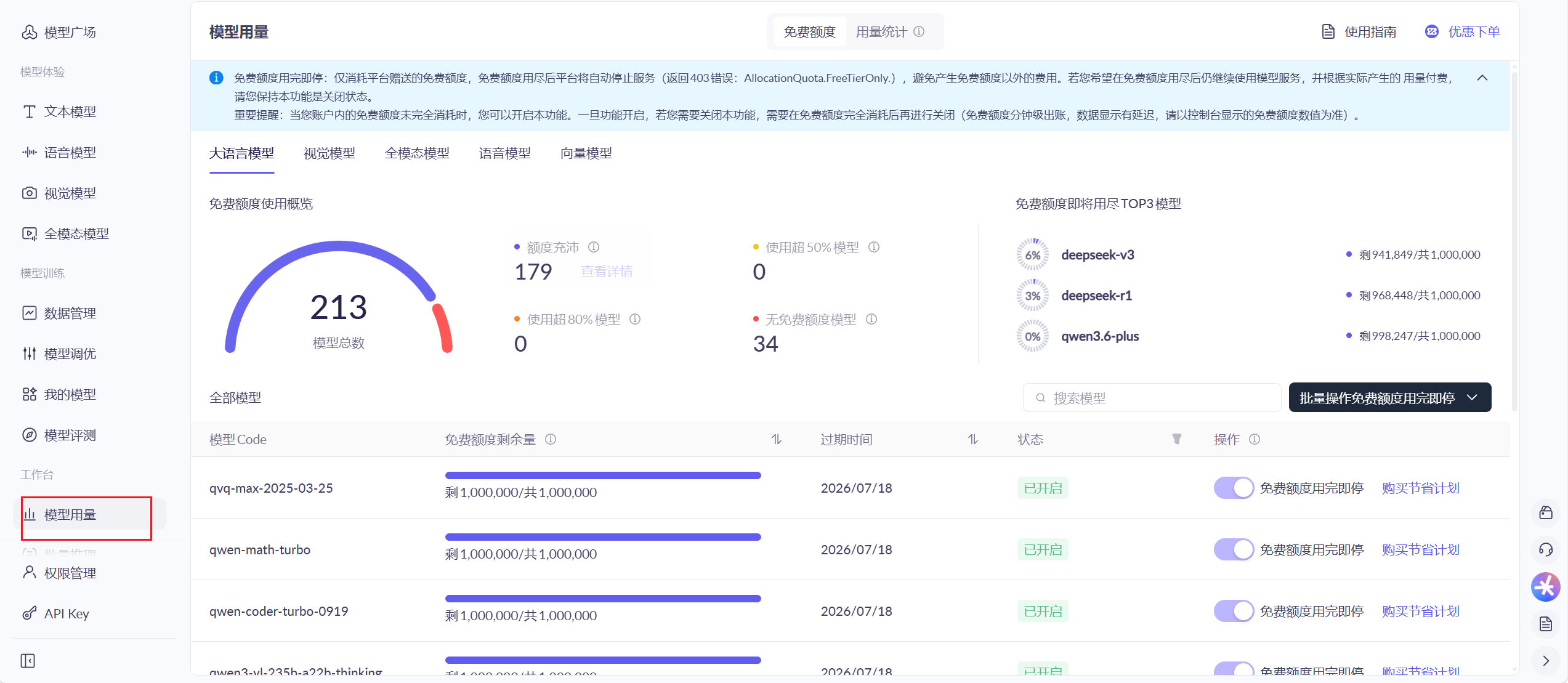

1.打开阿里百炼平台大模型服务平台百炼控制台,点击免费额度。

2.里面有170多个免费模型可用。

3. 申请apikey并复制下来

4.配置模型 测试正常即可使用

- 启用 LLM 答题 开关打开

- 点击底部保存按钮

- 刷新页面,配置才会生效

第四步:验证配置是否正确

保存后点击底部的 🔗 测试 LLM 按钮。

- 弹出「测试成功」→ 配置正确,可以正常使用

- 弹出错误信息 → 根据下方常见问题排查

常见问题

Q:测试 LLM 提示「401 Unauthorized」

API Key 填写有误。检查是否复制完整,Key 前后不要有多余空格。

Q:测试 LLM 提示「404 Not Found」

模型名称填错了。去对应平台的文档页确认模型 ID 的准确写法,注意大小写。

Q:测试 LLM 提示「insufficient balance」或「余额不足」

账户余额为零,需要充值。

Q:测试 LLM 一直转圈没有响应

- 如果用的是 OpenAI / Anthropic,检查科学上网是否正常

- 可以把「LLM 超时时间」改为「不设置」再试

- 国内供应商一般不需要代理,如果开了代理反而可能出问题

Q:题库有答案时会不会也调用 LLM?

不会。LLM 只在题库查询无结果时才触发,不会浪费 token。

Q:LLM 答错了怎么办?

AI 不保证 100% 正确,尤其是计算题和专业性强的题目。建议在「允许使用 LLM 的题型」里只勾选你信任 AI 的题型,其余题型手动作答。

参数说明

| 参数 | 说明 | 默认值 |

|---|---|---|

| 供应商预设 | 选择后自动填入 Base URL 和后缀 | openai |

| API Base URL | 接口基础地址 | https://api.openai.com/v1 |

| 请求路径后缀 | 拼接在 Base URL 后,最终地址 = Base URL + 后缀 | /chat/completions |

| API Key | 对应平台的密钥,保存时加密存储 | — |

| 模型名称 | 具体模型 ID,可手动输入任意值 | gpt-3.5-turbo |

| LLM 超时时间 | 30 秒 / 不设置;超时自动跳过该题 | 30 秒 |

| 最大输出 Token | 推理模型(如 deepseek-reasoner)建议调到 4000 以上 | 1000 |

| 允许使用 LLM 的题型 | 只有勾选的题型才会调用 AI | 全部勾选 |

自定义接口示例

对接本地 Ollama 或任意 OpenAI 兼容中转:

供应商预设: 自定义

API Base URL: http://localhost:11434/v1

请求路径后缀: /chat/completions

API Key: ollama(或留空)

模型名称: llama3

答题逻辑

脚本根据题型构造不同的 prompt,要求 AI 只返回答案本身:

- 单选题:只返回选项字母(如

A) - 多选题:返回所有正确字母,逗号分隔(如

A,C) - 判断题:只返回

正确或错误 - 填空题:多个空用

###分隔 - 其他主观题:直接返回答案文本

配置导入导出

导出:点击配置面板底部「📋 导出」,完整配置(含 API Key 明文)复制到剪贴板,JSON 格式,可用于备份或换设备时恢复。

导入:点击「📂 导入」,粘贴之前导出的 JSON,点击确定后配置加载到表单,再点保存生效。

API Key 在本地存储时经过简单编码(Base64 + 字符串反转),导出的 JSON 为明文,注意保管,不要分享给他人。

时间参数说明

| 参数 | 作用 | 默认值 |

|---|---|---|

| 通用间隔(秒) | 脚本各步骤之间的等待时间 | 3 秒 |

| 答题间隔(秒) | 每道题填写答案之间的间隔,模拟人工速度 | 3 秒 |

间隔过小可能触发平台风控,建议保持默认值。

注意事项

- 配置保存后需手动刷新页面才能生效

- 题库答案来源于第三方接口,准确率不保证,重要考试请自行核对

- 本脚本仅供学习交流,禁止用于商业用途